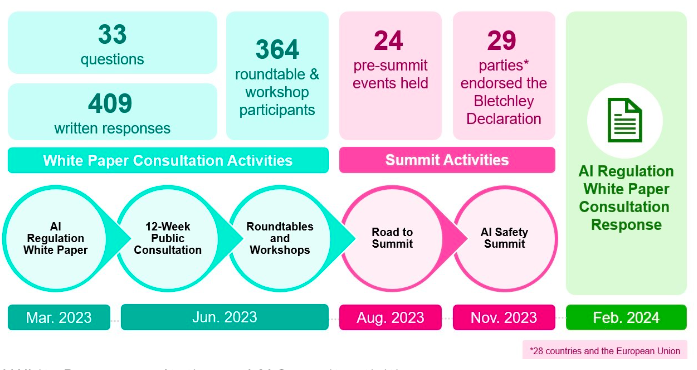

O governo do Reino Unido publicou nessa terça-feira (6) o resultado da consulta pública realizado em 2023, com o título “Consultation outcome, A pro-innovation approach to AI regulation: government response“. Em março de 2023, o Reino Unido publicou um documento apresentando propostas para estabelecer um arcabouço regulatório para a IA, a fim de promover uma inovação segura e responsável. Foram estabelecidos cinco princípios para que os reguladores interpretem e apliquem dentro de seus domínios. Também foram inclusas propostas para uma função central dentro do governo para conduzir uma série de atividades, como avaliação de riscos e coordenação regulatória, para apoiar a adaptabilidade e a coerência da abordagem. Com o documento, o governo lançou uma consulta pública de 12 semanas sobre as propostas e, agora, publicou as respostas dos questionamentos.

Conforme o documento, o governo prevê que o mercado de IA no Reino Unido cresça para mais de $1 trilhão (USD) até 2035, possibilitando desde novas habilidades e empregos até tratamentos inovadores para doenças como câncer e demência. O objetivo é tornar o Reino Unido líder global no desenvolvimento e implementação segura de IA. No documento, o governo lembrou que o Reino Unido realizou o primeiro Summit Mundial de Segurança em IA, formalizou a avaliação dos riscos apresentados pela IA avançada e estabeleceu o Instituto de Segurança em IA.

A publicação ainda afirma que o governo está investindo mais de £100 milhões para apoiar a inovação e regulação em IA. O esforço é parte do objetivo de ser uma superpotência em Ciência e Tecnologia até o final da década. O setor de IA do Reino Unido emprega mais de 50.000 pessoas e contribui significativamente para a economia.

Cinco princípios

No white paper de regulação da IA, o governo propôs cinco princípios intersectoriais para que os reguladores interpretassem e aplicassem dentro de suas jurisdições, a fim de promover uma inovação em IA segura e responsável. Os cinco princípios tiveram grande respaldo na consulta e incluem:

- segurança, proteção e robustez (safety, security and robustness);

- transparência e explicabilidade apropriadas (appropriate transparency and explainability);

- justiça (fairness);

- responsabilidade e governança (accountability and governance); e

- contestabilidade e reparação (contestability and redress).

Flexibilidade

Contrariando a tendência de impor regulamentações estritas desde o início, o documento sugere que os princípios regulatórios da IA sejam inicialmente estabelecidos fora do âmbito legal formal (“non-statutory basis”), ou seja, de maneira não legalmente obrigatória.

Esta proposta vem após um amplo processo de consulta, onde diversas partes interessadas tiveram a oportunidade de expressar suas visões sobre a melhor forma de governança da IA. Boa parte dos respondentes reconheceu os benefícios potenciais de uma estrutura regulatória mais rígida. No entanto, houve também um reconhecimento significativo de que uma abordagem inicial mais flexível poderia oferecer vantagens importantes, especialmente em termos de adaptabilidade e inovação.

O documento destaca que, embora a implementação de princípios regulatórios de IA em uma base não estatutária possa parecer menos rigorosa, ela permite uma experimentação e adaptação necessárias em um campo tão dinâmico e em rápida evolução como a IA. Essa flexibilidade é vista como crucial para entender melhor as implicações da tecnologia antes de se comprometer com regulamentações mais formais e potencialmente restritivas. O governo enfatizou também sua intenção de manter essa abordagem sob constante revisão. Isso indica uma abertura para ajustar sua estratégia conforme necessário, com o objetivo de equilibrar a inovação no setor de IA com a proteção adequada do público e dos interesses sociais.

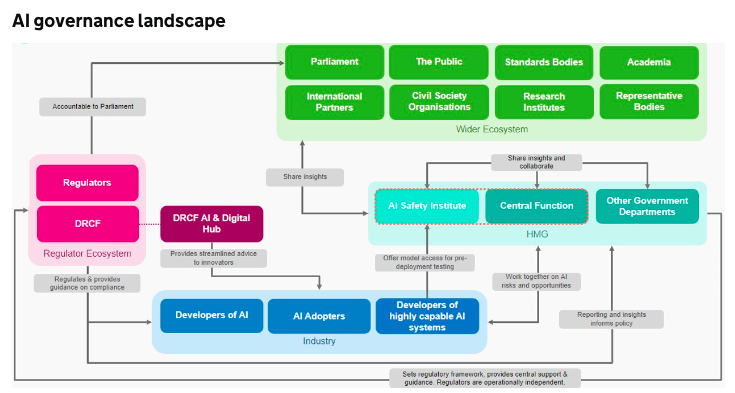

“Função Central”

A necessidade de uma resposta abrangente às mudanças sistêmicas impulsionadas pela IA foi enfatizada, destacando a importância de uma função central que foi amplamente acolhida pelos respondentes. A função visa evitar sobreposições regulatórias, lacunas e problemas de coordenação, oferecendo um ponto único de verdade sobre os riscos da IA e apoiando o trabalho do governo para identificar e priorizar ações em áreas onde a regulamentação existente pode ser ineficaz. Entre essas atividades de coordenação estão inclusos:

- Avaliação de Riscos: A formação de uma nova equipe multidisciplinar dentro do Departamento de Ciência, Inovação e Tecnologia (DSIT) para monitoramento de riscos setoriais cruzados.

- Capacidades dos Reguladores: Um investimento de £10 milhões para desenvolver as capacidades e ferramentas necessárias para que os reguladores possam responder de forma adaptável aos riscos e oportunidades da IA.

- Poderes Regulatórios: Uma análise dos poderes e mandatos dos reguladores do Reino Unido para garantir uma implementação consistente e abrangente dos princípios.

- Coordenação: A formação de um comitê de direção para facilitar a troca de conhecimentos e coordenação na governança da IA.

- Pesquisa e Inovação: Parcerias com a UK Research and Innovation (UKRI) para alinhar investimentos em P&D de IA com a agenda de segurança do governo.

- Ambiente de Conformidade Facilitado: Apoio aos inovadores e empresas através de um serviço consultivo multiagência para navegar pelos requisitos legais e regulatórios.

- Confiança Pública: Esforços contínuos para construir confiança nas tecnologias de IA, incluindo o desenvolvimento de técnicas de garantia e padrões técnicos.

- Monitoramento e Avaliação: Desenvolvimento de um plano de monitoramento e avaliação para avaliar continuamente a eficácia do regime regulatório.

Estas iniciativas sublinham o compromisso do governo do Reino Unido em liderar globalmente na regulação responsável da IA, equilibrando inovação com proteção ao consumidor e valores públicos. A abordagem proativa visa assegurar que o Reino Unido permaneça na vanguarda da pesquisa, desenvolvimento e aplicação ética da IA, promovendo ao mesmo tempo a confiança pública e a segurança nas tecnologias emergentes.

Apoio Forte aos Padrões Técnicos e Técnicas de Garantia na Regulação da IA no Reino Unido

O uso de padrões técnicos e técnicas de garantia na implementação dos princípios de Inteligência Artificial (IA) recebeu apoio significativo, conforme revelado por um recente feedback do setor. Muitos participantes da consulta destacaram a importância dessas ferramentas para ajudar as organizações a integrar os princípios da IA aos processos de negócios existentes. Os esforços do Hub de Padrões de IA do Reino Unido e do trabalho do Centro para a Ética dos Dados e Inovação (CDEI) em garantia de IA foram amplamente elogiados por sua contribuição vital para o avanço da IA confiável.

Um ponto de consenso entre os respondentes foi a necessidade de ferramentas e processos consistentes em todos os setores para reduzir o ônus da conformidade para as empresas. No entanto, a importância de ferramentas e processos específicos por setor também foi ressaltada, com sugestões para o complemento de padrões técnicos com estudos de caso e exemplos de boas práticas, visando uma adaptação mais efetiva aos princípios da IA.

Os participantes da consulta também argumentaram a favor de ferramentas e técnicas padronizadas para a identificação e mitigação de riscos potenciais relacionados à IA. Técnicas de garantia, como avaliações de impacto e risco, monitoramento de desempenho de modelos, avaliações de incerteza de modelos e red teaming, foram identificadas como particularmente úteis para identificar riscos de IA. Algumas sugestões incluíram técnicas de garantia para detectar e prevenir problemas, como deriva, para mitigar riscos relacionados a dados.

Governo Avalia Responsabilidade Legal na IA para Promover Inovação e Confiança Pública

O governo reconhece as complexidades na alocação justa e efetiva da responsabilidade legal ao longo do ciclo de vida da Inteligência Artificial (IA) e endossa a necessidade de intervenção governamental para assegurar uma distribuição adequada da responsabilidade na cadeia de valor da IA. As respostas a consultas recentes ressaltam a complexidade e a variabilidade das cadeias de suprimentos da IA, trazendo à tona questões éticas e técnicas expansivas.

Concordando com a dificuldade em encontrar respostas simples para a alocação de responsabilidade legal na IA, o governo britânico sublinhou a importância de acertar na responsabilidade e na accountability para apoiar a inovação e a confiança pública. Assim, assegurou que à medida que o quadro regulatório da IA for continuamente iterado, medidas seriam consideradas para alocar eficazmente a accountability e distribuir de forma justa a responsabilidade legal àqueles no ciclo de vida mais capazes de mitigar os riscos relacionados à IA. Segundo o whitepaper, este esforço visaria criar um ambiente propício à inovação tecnológica, ao mesmo tempo em que se garantiria a segurança, a justiça e a confiança do público nas aplicações de IA.

Para ler o documento completo, clique aqui.